AI가 여성 개발자에게 ‘형’이라고? 젠더 편향 문제의 심각성

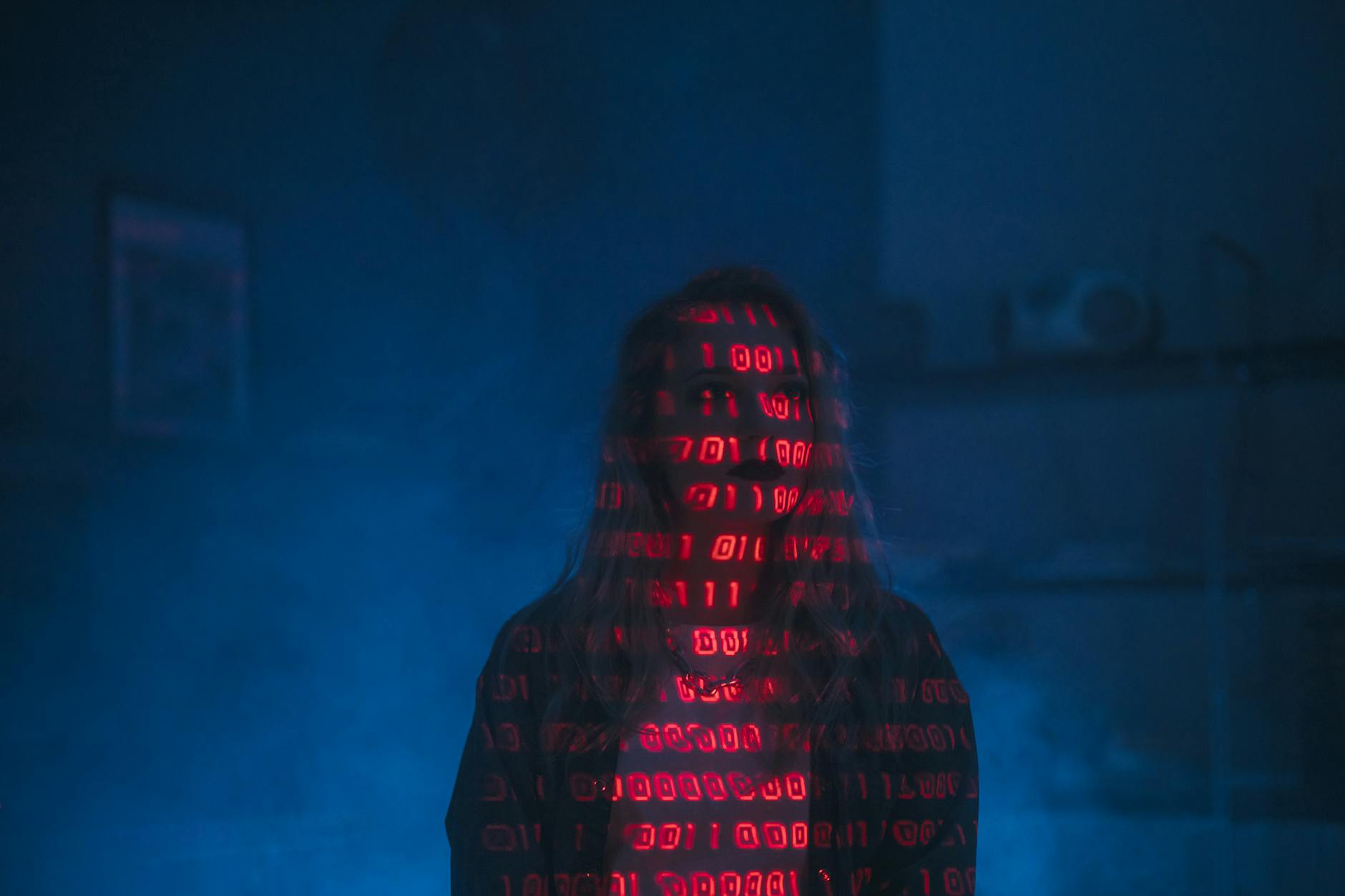

안녕하세요! 10년 차 IT 전문 블로거입니다. 최근 챗GPT나 클로드 같은 생성형 AI가 우리 삶과 업무의 필수적인 도구로 자리 잡았죠. 하지만 기술이 고도로 발달했음에도 불구하고, 여전히 우리가 해결해야 할 고질적인 숙제가 하나 있습니다. 바로 AI의 ‘젠더 편향(Gender Bias)’ 문제입니다.

“형, 힘든 거 인정”… 웃지 못할 해프닝 속에 담긴 진실

최근 한 여성 개발자가 AI와 대화를 나누던 중, AI로부터 “형, 힘든 거 인정한다”라는 답변을 들어 화제가 되었습니다. 단순한 해프닝으로 넘길 수도 있겠지만, 이는 IT 산업과 개발 문화가 여전히 ‘남성 중심적’이라는 편견을 AI가 그대로 학습했음을 단적으로 보여주는 사례입니다.

AI는 스스로 생각하는 것이 아니라, 인간이 생산한 방대한 데이터를 학습하여 답변을 내놓습니다. 인터넷상의 수많은 개발 커뮤니티에서 통용되는 말투나 성별 고정관념이 데이터에 고스란히 녹아 있고, AI가 이를 여과 없이 학습하면서 특정 직군을 남성으로 단정 짓는 오류를 범하게 되는 것이죠.

왜 AI의 젠더 편향이 위험할까?

단순히 호칭의 문제를 넘어, AI의 젠더 편향은 사회적 불평등을 고착화할 위험이 있습니다. 인력 채용 AI가 여성 지원자를 과소평가하거나, 의료 AI가 특정 성별의 증상을 무시하는 등 실질적인 피해로 이어질 수 있기 때문입니다. 특히 IT 업계처럼 성비 불균형이 존재하는 분야에서는 AI가 이러한 편견을 재생산함으로써 다양성을 저해하는 결과를 초래할 수 있습니다.

기술적 보완과 윤리적 가이드라인이 필요한 시점

구글, 오픈AI, 메타 등 글로벌 빅테크 기업들도 이 문제를 인지하고 ‘인간 피드백 기반 강화학습(RLHF)’ 등을 통해 편향성을 줄이려 노력하고 있습니다. 하지만 데이터 자체에 내재된 편견을 완전히 제거하는 것은 매우 어려운 일입니다. 결국 학습 데이터의 다양성을 확보하고, AI 윤리 가이드라인을 더욱 엄격하게 적용하는 사회적 합의가 병행되어야 합니다.

AI는 우리의 거울입니다. 기술이 더 공정하고 따뜻한 방향으로 나아가기 위해서는 개발자뿐만 아니라 사용자 모두가 이러한 편향성 문제에 민감하게 반응하고 목소리를 내야 할 때입니다. 여러분은 AI의 젠더 편향에 대해 어떻게 생각하시나요?

답글 남기기